近日,我院 2023 级计算机拔尖班贺绍凯同学,在计算机学院钟将教授、魏楷文老师的共同指导下,在大语言模型知识表征与推理能力研究领域取得进展,其研究成果以《DiffER: Diffusion Entity-Relation Modeling for Reversal Curse in Diffusion Large Language Models》为题,被自然语言处理领域国际顶级会议 ACL 2026(Findings)接收发表。

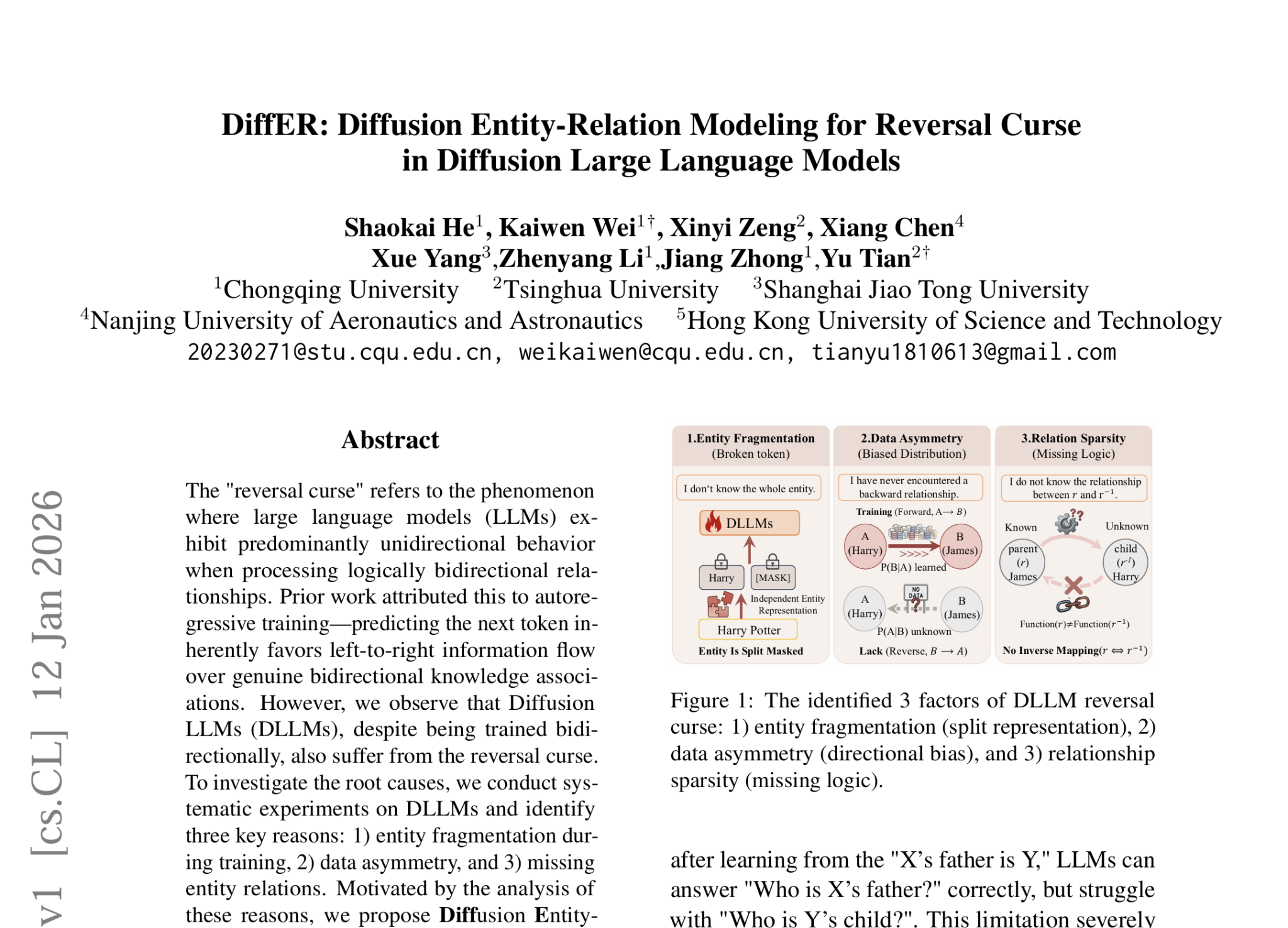

贺绍凯同学的研究聚焦扩散式大语言模型(Diffusion LLMs)中的"反转诅咒"(Reversal Curse)问题。所谓"反转诅咒",是指大语言模型在处理逻辑上双向对称的关系时表现出明显的单向性——例如模型能够回答"X的父亲是谁",却难以反向回答"Y的孩子是谁"。已有工作普遍将这一现象归因于自回归训练范式下从左到右的信息流偏置,然而贺绍凯同学及其合作者首次系统性地观察到:即使是天然采用双向训练的扩散式大语言模型,同样深陷"反转诅咒"之中。针对这一问题,论文从训练过程中的实体碎片化、数据非对称性以及关系建模缺失三个层面深入剖析根因,并提出整体实体掩码(Whole-Entity Masking)、对称数据增强(Symmetric Data Augmentation)以及逆向关系建模(Inverse Relation Modeling)三项关键技术。研究团队在 LLaDA-8B、Dream-7B 等当前主流扩散式大语言模型上进行了充分的实验验证,结果表明所提方法能够显著缓解扩散式大语言模型的反转诅咒现象,为大语言模型的双向知识关联建模提供了新思路,对推动新一代语言模型架构发展具有重要意义。

供稿:贺绍凯

编辑|周婧雯

审核|赖言宁、邹霞

学院动态

学院动态